性能より先に問われる管理可能性

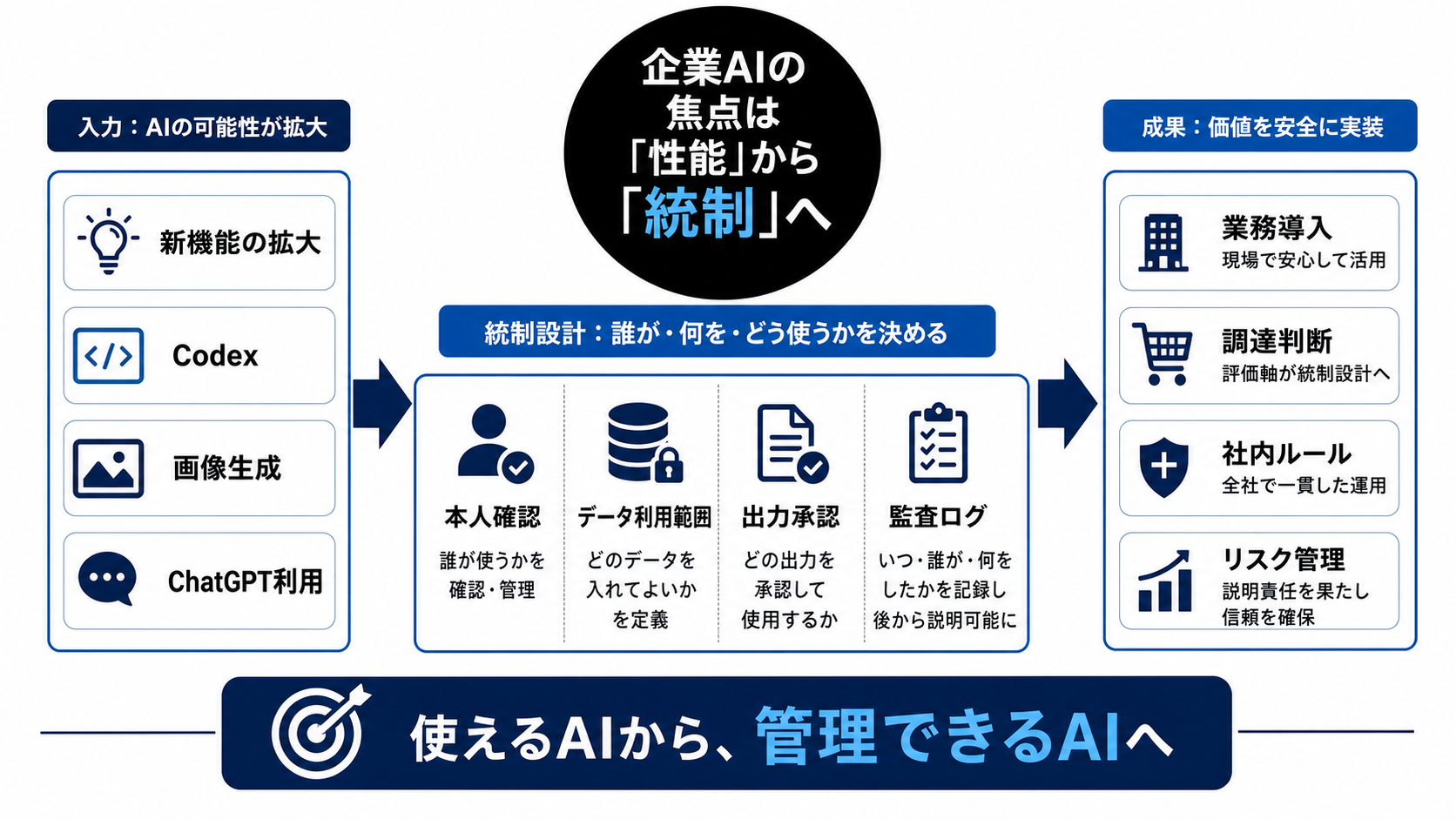

OpenAIをめぐる最近の材料は、ChatGPTのアカウント保護、Codexの業務利用、画像生成モデルの進化として別々に読めます。ただ、企業にとっては一つの問いに集約されます。AIを十分に賢い道具としてだけでなく、組織が管理できる業務基盤として扱えるのか、という問いです。

これまでAI導入の議論は、回答精度、処理速度、コスト、対応できる作業範囲に寄りがちでした。いま焦点になっているのは、その手前と後ろです。誰がアカウントに入れるのか。復旧は本人だけに限定できるのか。業務データは学習や保持の対象から外せるのか。生成されたコードや画像を、企業はどの手順で承認できるのか。

この変化は、AIベンダーにとっても大きい意味を持ちます。性能で先行するだけでは、企業の標準ツールにはなれません。社員のID、権限、ログ、知財確認、データ保持のルールに組み込めるかが、導入範囲を決めるようになります。

アカウント保護は小さな設定ではない

ChatGPTやCodexのアカウントは、単なるログイン先ではありません。そこにはプロンプト、添付ファイル、コードの文脈、社内業務の断片、顧客や製品に関する知識が残る可能性があります。アカウントが乗っ取られれば、メールやSNSの被害とは違い、仕事の判断材料や開発作業そのものに影響が及びます。

そのため、パスキーやハードウェアセキュリティキーを使った強い認証、弱い復旧経路の制限、侵害されたアカウントを学習対象から外す設計は、企業導入では安全機能というより利用許可の土台になります。CISOやIT部門は、社員がAIを使えるかどうかを、モデルの能力だけでなく本人確認と復旧手続きの堅さで判断します。

ただし、強い認証は摩擦も生みます。利用者には設定や復旧の手間が増え、管理者には例外処理が増えます。ここで企業が知りたいのは、個々の社員が任意で設定できるかではなく、管理者が全体方針として強制できるか、違反や復旧の履歴を確認できるかです。任意の安全機能なら影響は限定的ですが、管理可能な標準機能なら導入判断を変えます。

生成物が広がるほど、審査の仕事も増える

Codexのようなコーディング支援と画像生成の進化は、企業のAI利用を広げます。同時に、監査すべき対象も増やします。テキスト回答は内容の正確性が問題になり、コードはリポジトリ、秘密情報、ライセンス、レビュー責任に触れます。画像はブランド表現、著作権、人物や商標、地域ごとの表示ルールに関わります。

画像生成で文字の描画精度が上がれば、広告、教材、手順書、営業資料、社内文書に近い用途で使いやすくなります。これは便利さの拡大である一方、承認されないまま外部に出るリスクの拡大でもあります。出力が実務に使えるほど、企業は生成物の出どころ、修正履歴、レビュー責任を求めるようになります。

多言語の文字表現に制約が残る点も、単なる品質問題ではありません。グローバル企業では、英語圏で通るワークフローが日本語、中国語、ヒンディー語などで同じように通るとは限りません。文字の誤りや意味のずれを人手で補う必要があるなら、生成AIの便益は市場ごとに変わります。

導入を進める人と止める人は違う

開発者にとって、Codexの価値は速度です。調査、実装、テスト、修正の時間を短くできれば、開発チームの生産性は上がります。一方で、ソースコード、認証情報、顧客データ、社内APIの扱いには境界があります。便利でも、どのリポジトリを読ませてよいか、生成コードを誰がレビューするかが曖昧なら、業務利用は広げにくくなります。

セキュリティ部門と法務部門の関心は別です。本人確認を強制できるか、復旧経路を管理できるか、利用ログを残せるか、入力データがどこに保持されるか、生成物の知財リスクをどう説明できるかを見ます。ここが弱いと、現場が使いたがっても、全社標準にはなりません。

事業部門は、生産性を求めます。営業資料、提案書、FAQ、研修コンテンツ、開発支援など、AIで速くなる仕事は多いからです。ただし、部署ごとに勝手な使い方が広がると、データの持ち出し、未承認の外部公開、誤った説明、契約違反が生まれます。事業部門に必要なのは自由な実験だけではなく、使える範囲が明確な道具です。

利用者には、強い認証や利用ルールが増えるほど手間が増えます。ここで摩擦が大きすぎると、社員は承認済みの道具を避け、個人アカウントや別サービスへ流れる可能性があります。企業AIの統制は、厳しければよいわけではありません。安全性と使いやすさの均衡を取れなければ、かえって管理外の利用を増やします。

影響を大きくする変数

最初の変数は、適用範囲です。新しい保護策が無料、個人有料、Team、Enterprise、ChatGPT、Codexのどこまで広がるかで意味が変わります。個人向けの強化にとどまるなら、企業の標準化には直結しません。企業アカウントや開発者向け環境まで含むなら、調達と利用規程の見直しにつながります。

二つ目は、管理者がどこまで強制できるかです。認証方式、復旧手続き、学習除外、データ保持、監査ログを企業側が一元的に設定できるなら、AI利用はIT管理の中に入りやすくなります。逆に、ユーザー任せの設定が多いままなら、統制の責任は企業側に残り、導入の慎重さはあまり変わりません。

三つ目は、生成物の扱いです。コードや画像について、出力の由来、保持期間、編集履歴、レビュー記録、外部利用の可否が明確になるかが重要です。AIが作ったものを業務に使うほど、企業は成果物そのものを管理対象にします。

四つ目は、多言語と地域対応です。画像内テキストの精度や文化的な表現のずれが残ると、グローバル展開では市場ごとに審査コストが変わります。AIの能力が上がっても、承認プロセスが地域ごとに重ければ、導入の速度は均一にはなりません。

競争軸は配布と統制に移る

AIベンダーの競争は、モデル性能だけでは決まりません。企業がAIを標準化する段階では、既存のID管理、端末管理、データ分類、監査、法務レビューとつながることが重要になります。どれだけ賢いモデルでも、管理画面が弱く、ログが不十分で、データ利用の説明が曖昧なら、企業の導入範囲は限定されます。

ここで競争力になるのは、配布力と統制力の組み合わせです。社員が日常的に触る場所にAIを配れること。管理者が利用範囲を定められること。法務とセキュリティが説明に使える証跡を取れること。この三つがそろうほど、AIは実験ツールから業務基盤に近づきます。

競合にとっても機会があります。OpenAIよりモデル性能で劣っていても、ID連携、監査ログ、データ保持、生成物の出どころ、管理者向けの既定設定を分かりやすくまとめられれば、企業導入では選ばれる余地があります。反対に、OpenAIがこれらを企業プランに深く組み込めば、性能優位を導入優位へ変えられます。

導入判断が変わる三つの道筋

影響が小さい道筋は、新しい統制機能が任意で狭い範囲にとどまる場合です。この場合、ニュースの意味はアカウント保護の改善に近くなります。個人利用や一部の有料ユーザーには効いても、企業の調達、法務審査、全社展開の判断を大きく動かす材料にはなりにくいでしょう。

影響が大きくなる道筋は、企業管理者が認証、復旧、ログ、学習除外、データ保持を明確に設定できる場合です。そうなれば、AIの利用可否は部署ごとの判断から、企業全体の統制設計へ移ります。導入のスピードは、モデルの新機能よりも、管理者が説明できる項目の数で変わります。

さらに大きな道筋は、知財、監査、誤用、情報流出の事例が重なり、規制や業界標準の議論が前面に出る場合です。その時は、AIベンダーの比較軸が、回答性能や価格から、本人確認、データ保護、生成物の証跡、責任分界へ移ります。企業はAIを使うかどうかではなく、どの統制条件を満たすサービスだけを許可するかを決めるようになります。

追うべき材料

この話を追う時、孤立したデモや新機能だけを見ても判断は定まりません。重要なのは、ChatGPT、Codex、画像生成をまたいで、同じ統制面が整っていくかです。認証を強くできるか。復旧を弱い経路に戻さないか。管理者が設定を強制できるか。ログとデータ保持を説明できるか。生成物を承認フローに載せられるか。

企業導入の問いは、モデルが印象的かどうかではありません。組織が、誰に使わせ、何を入力させ、どの出力を承認し、後から責任を説明できるかです。この条件を満たすほど、AIは現場の便利な補助から企業の標準インフラに近づきます。満たせなければ、性能が上がっても利用は部署単位や個人単位に散らばります。

OpenAIの最近の動きは、企業AIがその分岐点に入ったことを示しています。競争の中心が性能から統制へ完全に移ったわけではありません。ただ、企業が大規模にAIを採用するほど、勝敗を分けるのは、モデルの強さだけでなく、配布、権限、データ、監査を一体で扱えるかになります。