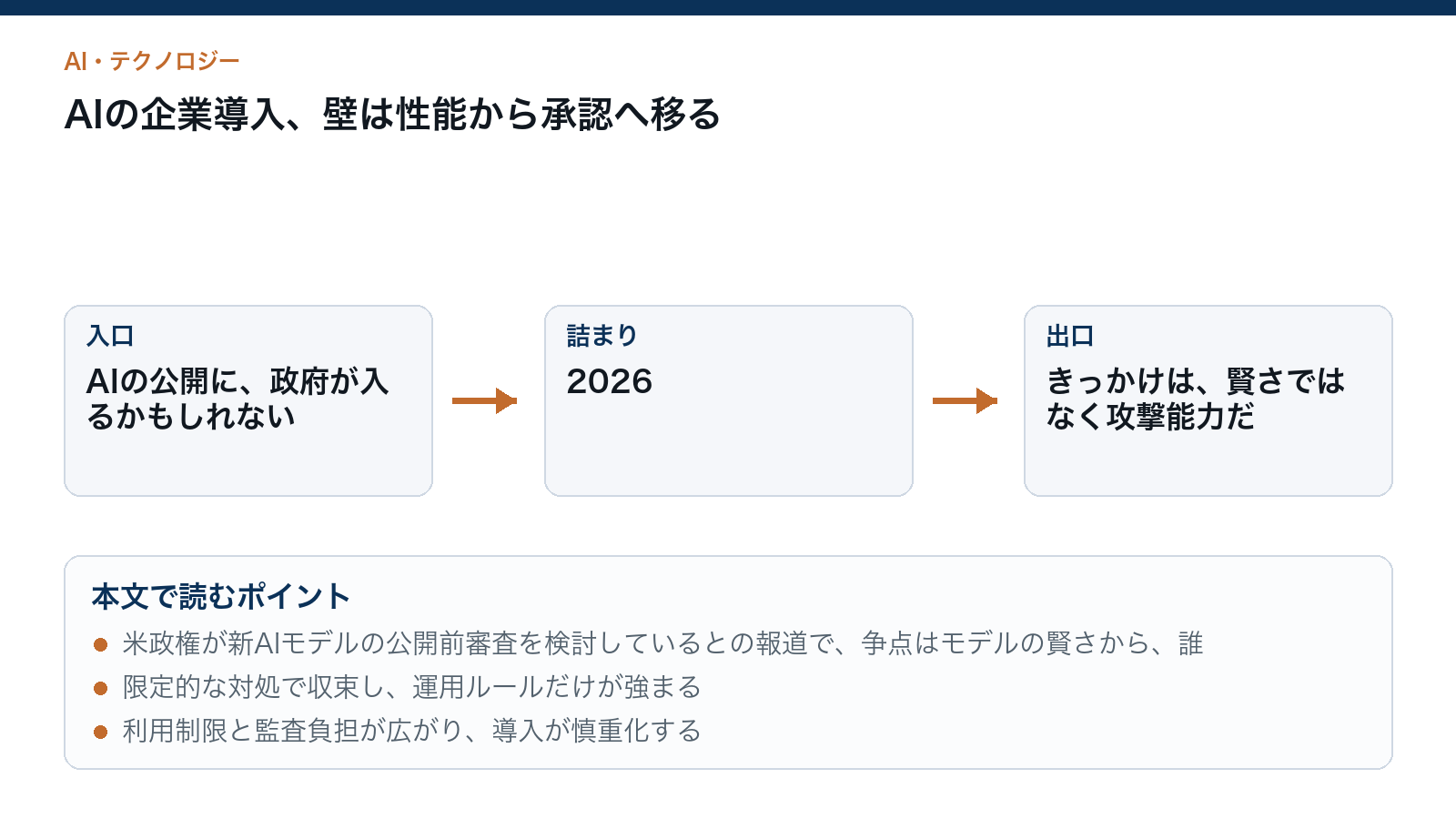

AIの公開に、政府が入るかもしれない

2026年5月4日、米紙はトランプ政権が新たなAIモデルの公開前審査を検討していると報じた。日本では5月5日に共同通信などが伝えた。まだ決まった政策ではなく、ホワイトハウス側は報道内容を臆測としている。まず分けて読むべきなのは、検討されていることと、制度として始まったことは違うという点だ。

それでも、この報道が重要なのは、政府の関与が「AIを使った後の問題」ではなく「公開する前の確認」に向かう可能性を示したからだ。モデルの性能が上がれば、企業は早く出したい。政府は、安全保障上のリスクを見たい。この二つが公開時点でぶつかり始めている。

きっかけは、賢さではなく攻撃能力だ

警戒されているのは、AIが便利になることそのものではない。報道では、Anthropicの生成AI「クロード・ミュトス」などが焦点として挙げられ、先端AIが脆弱性の発見やサイバー攻撃に悪用されるリスクが問題視されている。

つまり、技術的に変わったのは、性能向上が単なる品質競争では済まなくなったことだ。モデルが高度な推論やコード生成を行えるほど、攻撃手順の発見、脆弱性探索、自動化された悪用支援につながる懸念が強まる。公開範囲や提供判断が、能力リスクと直接結びつき始めた。

この変化は、価格や速度よりも先に配布範囲へ効く。高性能モデルほど、誰に、どの機能を、どの条件で出せるのかが問われる。利用者から見れば、機能制限や提供の遅れとして現れる可能性がある。企業から見れば、使えるかどうかの前に、説明できるかどうかが問題になる。

規制緩和の政権が、なぜ向きを変えるのか

トランプ政権は、米企業の主導権確保や対中競争を重視し、AI開発を過度に縛らない姿勢を取りやすいと見られてきた。その政権が公開前審査を検討していると報じられたことに、今回の逆説がある。

背景にあるのは、AIの想定外の進化が政治的被害や国家安全保障上のリスクに変わり得るという圧力だ。サイバー攻撃に使える能力が広く公開され、重大な被害が起きれば、政府は「企業の自主判断に任せた」と批判される。開発を速めたい政権ほど、深刻な事故で競争政策そのものが止まるリスクも抱える。

このため、米国の悩みは規制するかしないかではなく、開発速度を落としすぎずに、どこで公開の制御をかけるかに移っている。対中競争では速さが必要だが、安全保障では確認が必要になる。この緊張が制度設計の中心になる。

任意の評価と、義務的な審査は違う

同じ時期に、Microsoft、Google、xAIが米商務省のCAISIに新AIモデルへの早期アクセスを認める合意を結んだとも報じられた。これは、政府評価が企業の協力ベースで進む可能性を示す動きだ。

ただし、任意の早期アクセスと、義務的な公開前審査は意味が違う。前者は企業が政府に評価機会を与える協力に近い。後者は、公開時期や公開条件に政府の判断が影響する仕組みに近づく。

義務化されれば、AI企業にとっては公開遅延、承認条件、対象機能の限定が競争条件になる。先に出せる会社が勝つという単純な速度競争から、政府評価を通せる会社、企業秘密を守りながら安全性を示せる会社が有利になる競争へ変わる可能性がある。

企業導入の壁は、性能から承認へ移る

企業利用への影響は、すぐに全社導入が止まるという単純な話ではない。むしろ、法務、知財、セキュリティ、調達承認の比重が増す。モデルが高性能でも、利用範囲、データの扱い、監査証跡、事故時の責任が説明できなければ、業務の中核には入れにくい。

開発者にとっても、選ぶ基準は変わる。どのモデルが最も賢いかだけでなく、どの機能を社内規程に沿って使えるか、ログを残せるか、権限を分けられるか、監査時に説明できるかが問われる。AIを組み込むSaaS企業も、顧客企業のCISOや調達部門に対して、安全評価と利用制限を説明する必要が強まる。

利用者には二つの形で影響が出る。ひとつは、最新機能の提供が遅れたり、一部機能が限定されたりする不便さだ。もうひとつは、業務利用で信頼しやすい形に整備される利点である。企業導入の本当の壁は、モデル性能ではなく、組織が責任を持って使える状態にできるかへ移っていく。

次に見るのは、制度の名前ではなく運用の硬さだ

続報で見るべき第一の点は、公開前確認が義務か任意かだ。任意評価なら、企業協力と安全性アピールの延長にとどまる。義務化されれば、公開のタイミングと条件に政府が実質的な影響を持つ。

第二に、評価基準と対象モデルの閾値が重要になる。どの能力を超えたモデルが対象になるのか。評価項目はサイバーだけか、バイオ、化学、軍事転用まで含むのか。ここが曖昧なままだと、企業は開発計画を読みづらくなる。

第三に、差し止め権限、公開条件、審査期間、企業秘密保護の設計を見る必要がある。政府が何を見られるのか、企業のモデル重み、未公開機能、評価情報をどう守るのかが決まらなければ、制度は信頼されにくい。

この見立てが変わる条件は明確だ。大統領令や法案で審査が正式化される、CAISI評価が公開条件に近づく、主要AI企業が公開計画を調整する、または企業のAI利用規程や調達条件が政府評価の有無を求め始める。その時、AI競争の主戦場はモデルの賢さだけでなく、配布権限、安全評価、監査インフラへ移ったと言える。