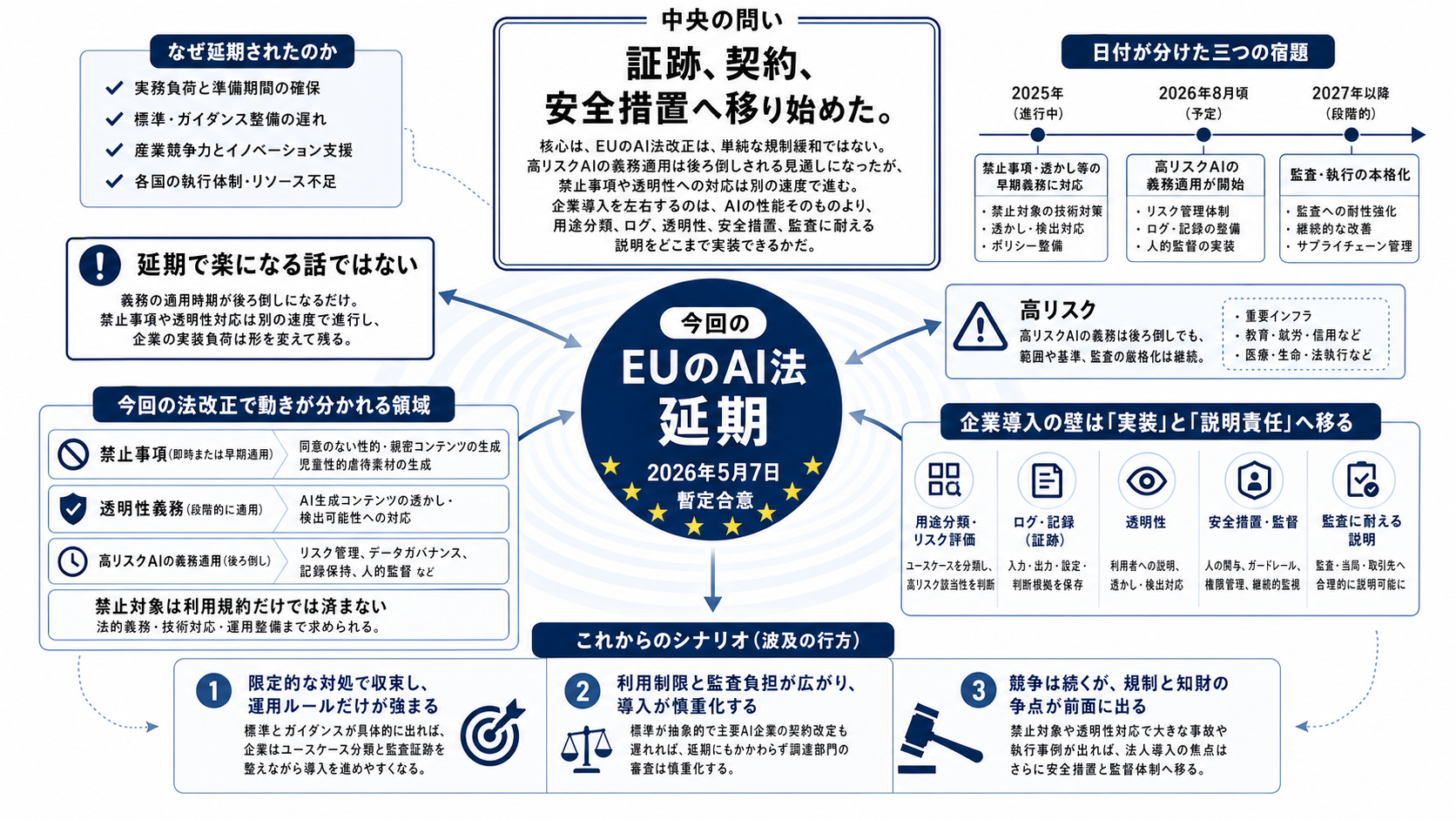

延期で楽になる話ではない

今回のEUのAI法改正を「規制が緩んだ」とだけ読むと、企業導入の実務を見誤る。2026年5月7日にEUの共同立法者が暫定合意したのは、高リスクAIの義務適用を後ろへずらしながら、生成被害や透明性の領域は別の速度で締める組み替えだ。正式に効力を持つには、欧州議会とEU理事会の正式採択がまだ残る。

変わった前提は、AI導入の壁がモデルの性能や速度だけでは測れなくなったことだ。企業は、どの用途が高リスクに当たるのか、生成物を検出可能にできるのか、禁止対象を避ける安全措置を説明できるのか、監査で後から追える記録を残せるのかを問われる。競争軸は、モデルの賢さだけでなく、配布地域、データ管理、契約、権限設定、監査対応へ広がる。

日付が分けた三つの宿題

高リスクAIの義務適用は二つの日付に分かれる。用途別に列挙された独立型システムは2027年12月2日、製品に組み込まれた高リスクシステムは2028年8月2日に先送りされる見通しだ。独立型の業務AIと、機械や医療機器などに組み込まれるAIでは、準備すべき証跡、評価、製品安全との関係が異なるため、同じ延期として扱うべきではない。

一方で、AI生成コンテンツの透かし・検出可能性に関する義務は2026年12月2日が新たな期限とされる。これは、開発者やAI提供企業にとって、モデル性能の改善とは別に、出力物を識別し、企業顧客に説明し、利用規約やAPI仕様へ反映する作業を先に求める。高リスク義務の延期は準備期間を与えるが、透明性対応の時計は先に進む。

禁止対象は利用規約だけでは済まない

合意には、同意のない性的・親密コンテンツや児童性的虐待素材を生成するAIシステムへの新たな禁止が含まれる。ここは企業向け導入の印象以上に重要だ。禁止は、問題のある出力を利用規約で禁じるだけでは足りず、どのような入力、用途、生成結果を防ぐのかを技術と運用の両方で示す必要がある。

AI提供企業は、安全フィルター、検出、通報、ログ、法人契約での利用目的制限を前倒しで整える圧力を受ける。導入企業も、従業員が使う生成AIや顧客向け機能が禁止対象に近づかないよう、社内ルールとシステム設定を結びつけなければならない。利用者保護の領域では、速度や価格より、被害を防ぐ設計を説明できるかが競争力になる。

導入企業の壁は監査証跡にある

EU域内でAIを使う企業にとって、延期で最も大きい意味は、導入判断の前にユースケースを棚卸しする時間が生まれたことだ。採用、教育、与信、医療、重要インフラなど、どの業務が高リスク分類に近いのかを調達前に見極めなければ、後からログ、説明、データ処理、登録対応を足すことになる。

その負担は法務だけで完結しない。情報システム部門はアクセス権限とログを設計し、現場部門は利用目的と業務手順を明文化し、調達部門はベンダー契約に透明性、監査、データ処理、提供停止時の扱いを入れる必要がある。AIの導入スピードを遅らせるのは、モデルの性能不足ではなく、社内で責任を分担できないことになる。

負担が軽くなる企業と残る企業

簡素化の恩恵を受けやすいのは、一部の中小企業と小規模ミッドキャップだ。改正案は、免除や負担軽減の対象を広げる方向を含み、すべての企業に同じ事務負担を課す設計からは一歩引く。規制対応の専任チームを持ちにくい企業にとっては、導入検討を止めずに済む余地が生まれる。

ただし、登録、データ処理、禁止対象を避ける安全措置、透明性の説明は残る。軽くなるのは一部の手続きや重複であって、説明責任そのものではない。AIを提供する企業、AIを組み込んだ製品をEU市場に出す企業、法人顧客へ大規模に配布する企業ほど、対応コストを契約や価格にどう反映するかが次の経営判断になる。

製品メーカーは二つの規制をまたぐ

機械、医療機器、玩具、リフトなどの製品にAIを組み込む企業では、AI法だけでなく分野別の安全規制との重なりが問題になる。今回の合意は、こうした重複を減らす方向を含むため、製品メーカーにとっては導入の見通しを立てやすくする可能性がある。

それでも、安全水準の説明責任は消えない。AIが製品の判断や制御に関わるなら、誤作動、データ品質、利用者への説明、更新後の挙動をどう管理するかが問われる。製品メーカーの競争力は、AI機能を早く足すことだけでなく、既存の安全認証や品質管理にAIの証跡を無理なく組み込めるかで決まる。

次に見るのは標準と企業契約

判断材料は四つある。第一に、欧州議会とEU理事会の正式採択がいつ完了するか。第二に、高リスクAI向けの標準とガイダンスが、企業のチェックリストに落とせる粒度で出るか。第三に、2026年12月2日に向けた透かし・検出可能性の実装指針が、開発者や法人顧客にとって現実的か。第四に、EU AI Officeと加盟国当局の監督分担が明確になるかだ。

早い信号は、主要AI企業のEU向け利用規約、法人契約、API仕様、安全措置の改定に出る。禁止対象生成をどう防ぐのか、ログや検出可能性をどこまで提供するのか、企業顧客にどの責任を求めるのかが明確になれば、導入企業の調達判断は進みやすい。逆に標準が抽象的で、契約条項も曖昧なままなら、高リスク義務が延期されても導入の慎重姿勢は残る。

このニュースの見方

今回の合意は、AI企業に与えられた単純な猶予ではない。企業導入の順番を組み替える合図だ。高リスクAIの本格対応は後ろへずれるが、透明性、禁止対象、安全措置、利用目的管理は先に整える必要がある。

今後の変化を読む時は、規制が強いか弱いかではなく、どの作業が誰に移ったのかを見るべきだ。AI提供企業には検出可能性と安全措置、導入企業には用途分類と監査証跡、製品メーカーには分野別安全規制との整合が求められる。ここを早く実装できる企業ほど、EU市場での配布と法人導入を進めやすくなる。